Ollama: локальная установка моделей на ПК Windows

Ollama – это кросс-платформенный инструмент с открытым API и командным интерфейсом, созданный для локального запуска и управления большими языковыми моделями (LLM) прямо на вашем устройстве. Он предлагает удобную интеграцию через HTTP-API и CLI, при этом не требует доступа к удалённым серверам, что обеспечивает высокую степень конфиденциальности и защиты обрабатываемой информации.

Другими словами, Ollama позволяет локально устанавливать большие языковые модели (LLM), такие как GPT-OSS 120B/20B, DeepSeek-R1 8B, Gemma3 1B/4B/12B/27B, Gemma3n E2b/E4b, Qwen3 4B/8B/30B, на компьютер и работать с ними без подключения к Интернету.

Сравнение моделей GPT-OSS, DeepSeek-R1, Gemma3 (3n), Qwen3

| Модель (Версия) | Процессор | Память (RAM) | Видеокарта | Объем на диске |

|---|---|---|---|---|

| GPT-OSS:120B | 16+ ядер, AVX2/AVX-512 | 64-80 ГБ | NVIDIA H100 80 ГБ | 65 ГБ |

| GPT-OSS:20B | 8+ ядер, AVX2 | 14-16 ГБ | RTX 4090 24GB | 14 ГБ |

| DeepSeek-R1:8B | 8+ ядер, AVX2 | 16 ГБ | RTX 4080 16GB | 8-10 ГБ |

| Gemma3:1B | 4+ ядра, x86-64 | 4-8 ГБ | Intel Arc A770 16GB | 2-3 ГБ |

| Gemma3:4B | 6+ ядер | 8-16 ГБ | RTX 3060 12GB | 6-8 ГБ |

| Gemma3:12B | 12+ ядер | 16-32 ГБ | RTX 3090 24GB | 20 ГБ |

| Gemma3:27B | 16+ ядер, AVX2 | 32-64 ГБ | NVIDIA A100 40GB | 45 ГБ |

| Gemma3n:E2b | 4-6 ядер | 16-24 ГБ | RTX 2060 6GB | 10-15 ГБ |

| Gemma3n:E4b | 6+ ядер | 24-32 ГБ | GPU 16-20 ГБ | 15-20 ГБ |

| Qwen3:4B | 8+ ядер | 8-16 ГБ | RTX 4070 12GB | 6-8 ГБ |

| Qwen3:8B | 12+ ядер | 16-32 ГБ | RTX 4080 16GB | 15-20 ГБ |

| Qwen3:30B | 24+ ядра, AVX2 | 64 ГБ | NVIDIA A100 40GB | 50 ГБ |

Скачать Ollama и установить LLM-модели локально на ПК Windows 11/10

- Перейдите на официальный сайт и загрузите Ollama, после чего установите.

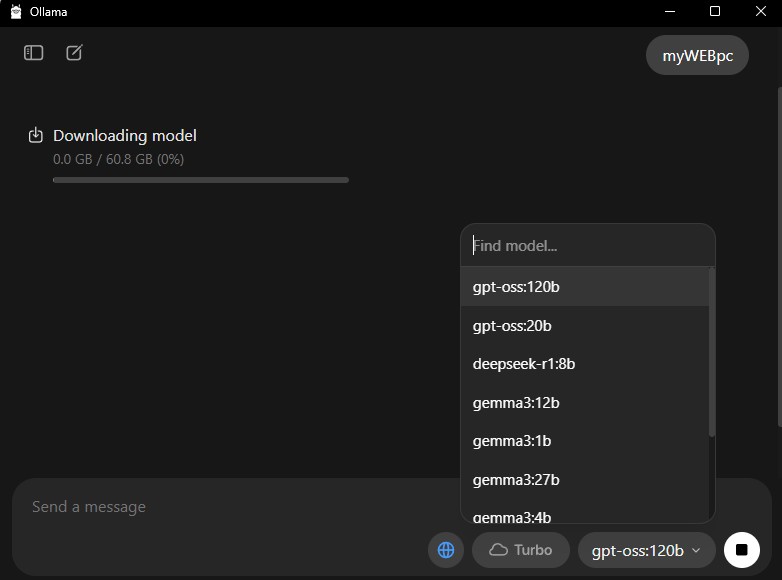

- Запустите Ollama, где будет выбор моделей LLM, таких как gpt-oss:120b, gpt-oss:20b, deepseek-r1:8b, gemma3:12b, gemma3:1b, gemma3:27b, gemma3:4b, qwen3:30b, qwen3:4b, qwen3:8b. Выберите нужную и отправьте любое сообщение, чтобы начать локальную установку определенной модели на компьютер. После установки модели, можете смело приступить к общению с LLM моделью. Отмечу, что не все модели LLM имеются в самой программе, если нужны модели как Gemma3n E2b/E4b, llama4 и другие, то обратитесь к способу 4 ниже через установку командной строки.

Как установить Ollama и языковые модели при помощи CMD в Windows 11/10

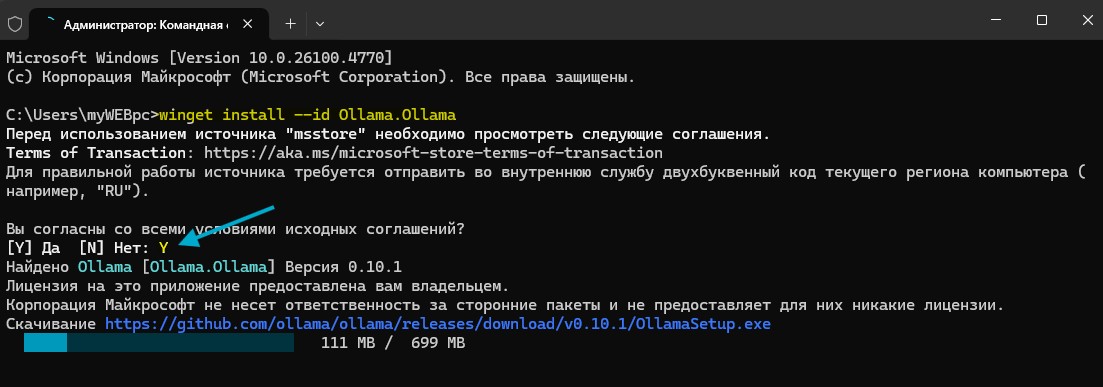

- В Windows 11/10 можно скачать, установить и пользоваться Ollama и моделями можно через командную строку. Запустите командную строку от имени администратора и введите ниже команду, чтобы установить Ollama, если она не установлена.

winget install --id Ollama.Ollama- После ввода выше команды нажмите Y и Enter, чтобы принять соглашение.

- Дождитесь скачивания и установки Ollama на ПК с Windows.

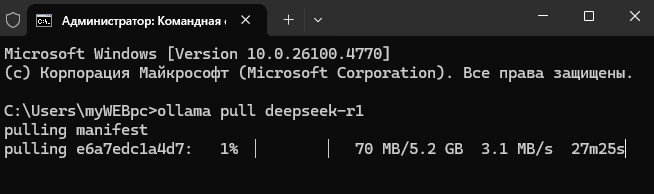

- После установки Ollama нужно установить LLM модель, которая вам нужна.

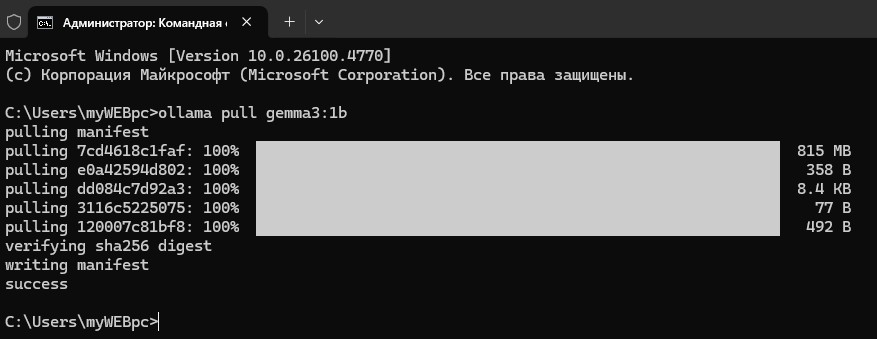

- Введите

ollama pull gemma3:1bдля установки модели. - Замените в команде модель на нужную, вместо gemma3:1b.

- В приложение ollama нет установки gemma3n:e2b и e4b, чтобы установить их введите:

ollama pull gemma3n:e2bиollama pull gemma3n:e4b. - Это касается и других моделей LLM,если будет нужно.

- Введите

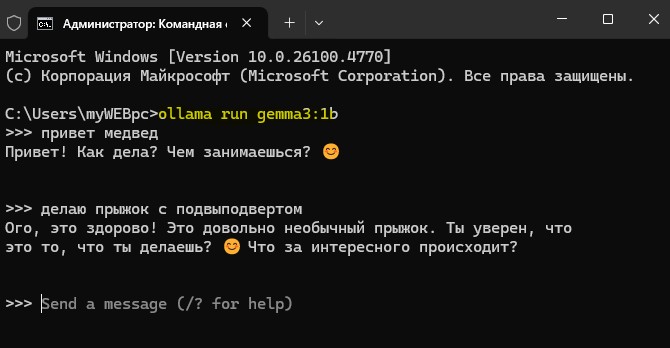

- Чтобы общаться с моделью gemma3:1b в командной строке, введите следующую команду.

ollama run gemma3:1b.- Задайте вопрос или задачу.

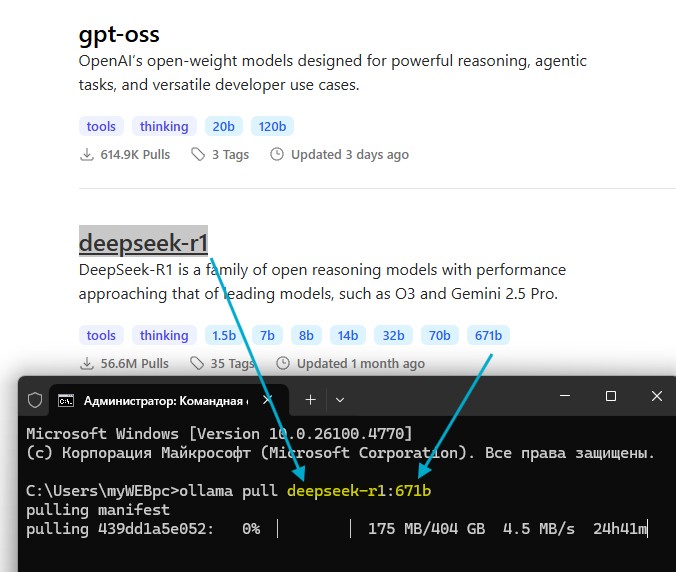

- Перейдите на официальный сайт для загрузки LLM-моделей Ollama через командную строку. Посмотрите на сайте название модели и версию, после чего введите команду ниже, где "ollama pull" - запуск ollama, "deepseek-r1" - модель нейросети и ":671b" - версия модели.

ollama pull deepseek-r1:671b

- Кроме того, можно установить просто модель без версии введя

ollama pull deepseek-r1.

- Другие команды Ollama в CMD:

- Мультимодальный (с изображениями):

ollama run gemma3:1b --image ./path/to/image.jpg. - Одноразовые запросы с текстом и изображением:

ollama run gemma3:1b --prompt "Что такое хвощь"иollama run gemma3:1b --prompt "Что на фото" --image ./cat.png. - Показать список установленных моделей:

ollama list. - Удаление моделей:

ollama remove gemma3:1b. - Отображает сведения о модели:

ollama show gemma3:1b. - Команды для справки:

ollama --helpиollama run --help.

- Мультимодальный (с изображениями):

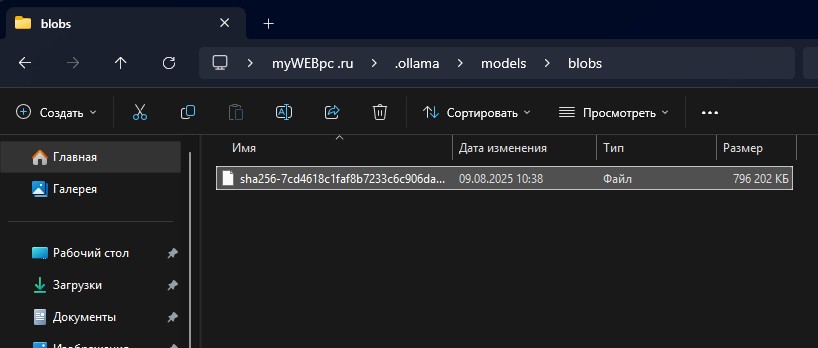

Где Ollama хранит модели на Windows 11/10?

- Нажмите сочетание кнопок Win+R и введите

%USERPROFILE%\.ollama\models.- Откроется сразу папку, где будут расположены LLM модели Ollama. Возможно придется открыть папку "Blobs".

- Откроется сразу папку, где будут расположены LLM модели Ollama. Возможно придется открыть папку "Blobs".

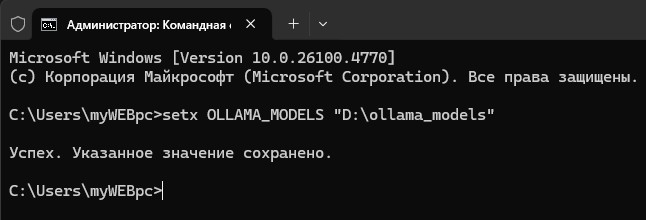

- Если нужно сохранить модели на другой диск, чтобы по умолчанию системный C:\ не забивался данными, то введите:

setx OLLAMA_MODELS "D:\ollama_models".- Закройте все окна и перезагрузите ПК, после чего Ollama будет сохранять модели по новому пути.

- Если нужно перенести уже установленные модели, перейдите по пути C:\Пользователи\Имя пользователя\.ollama\models\blobs и скопируйте модели по новому пути.

- Удалите старые модели с системного диска, чтобы освободить пространство.

myWEBpc

myWEBpc